10 月 22 日消息,康奈爾大學最新研究指出,大語言模型(LLM)在長期接觸低質量網絡內容后可能出現類似“大腦退化”(brain rot)的現象,其理解力、推理力及倫理一致性均顯著下降。

這一發現令業界再次聚焦“死網論”(Dead Internet Theory)—— 即網絡因充斥機器生成或低質內容而逐漸失去人類創造力的假說。

AI 性能受“低質數據”影響顯著

研究團隊以 Meta 的 Llama 3 和阿里云 Qwen 2.5 為實驗對象,通過構建不同質量比例的數據集,測量低質量內容對模型性能的影響。

結果顯示,當模型僅以低質量內容進行訓練時,其準確率從 74.9% 驟降至 57.2%,長文本理解能力從 84.4% 降至 52.3%。

研究人員還指出,這種“劑量 — 反應效應”(dose-response effect)意味著模型在持續接觸低質數據后會出現逐步退化現象,不僅推理鏈條被簡化甚至跳過,生成的回答也更表面化。此外,模型的倫理一致性下降,出現“人格漂移”(personality drift)傾向,更容易輸出錯誤信息。

“死網論”引發科技圈擔憂

近幾個月,多位科技界人士公開表達了對“死網論”的擔憂。Reddit 聯合創始人 Alexis Ohanian 表示:“如今互聯網上的很大一部分實際上已經‘死了’—— 無論是機器生成的、半 AI 的內容,還是充斥著低質量信息的社交平臺。”他呼吁未來的社交網絡應能“驗證人類真實性”。

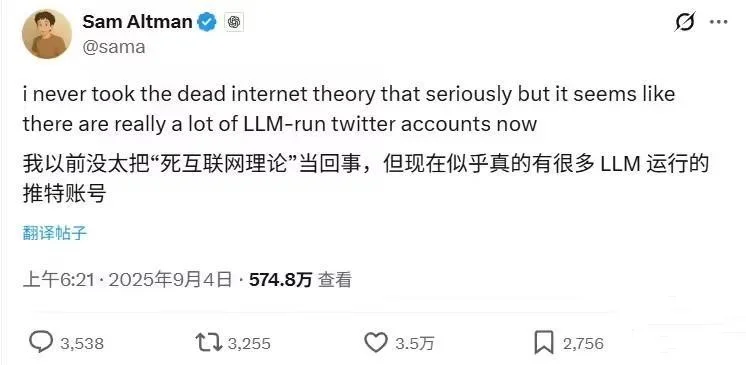

OpenAI 首席執行官 Sam Altman 也持類似觀點,認為“死網論正在我們眼前發生”,并稱現今多數 X(前 Twitter)賬號已由 AI 接管運營。

網絡內容質量危機正在加劇

亞馬遜云科技(AWS)研究團隊去年發布的報告指出,目前約有 57% 的網絡內容是由人工智能生成或翻譯的,這一趨勢正影響搜索結果的質量與可靠性。

前 Twitter 首席執行官 Jack Dorsey 亦警告,由于圖像生成、深度偽造(deepfake)與視頻合成技術的普及,“我們將越來越難分辨真假”,用戶必須通過親身體驗來驗證信息真偽。

隨著 AI 生成內容的快速擴散,互聯網正面臨內容質量與真實性的雙重考驗。業內專家提醒,如果人工智能模型與網絡生態繼續陷入低質量循環,所謂“死網論”終有一天會成為現實。